四 HDFS的数据流

4.1 HDFS写数据流程

4.1.1 剖析文件写入

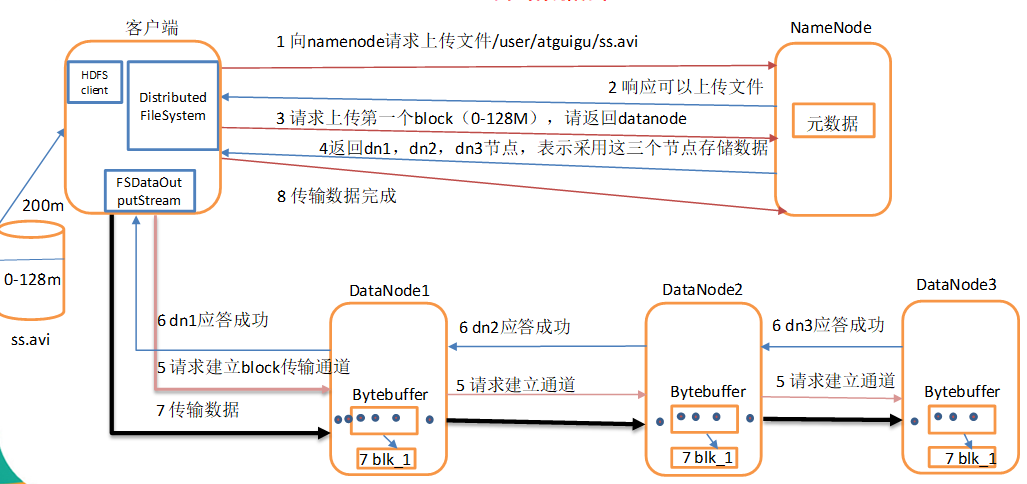

1)客户端通过Distributed FileSystem模块向namenode请求上传文件,namenode检查目标文件是否已存在,父目录是否存在。(存在覆盖,不存在创建)

2)namenode返回是否可以上传。

3)客户端请求第一个 block上传到哪几个datanode服务器上。

4)namenode返回3个datanode节点,分别为dn1、dn2、dn3。(根据配置文件中指定的备份数量及机架感知原理进行文件分配)

5)客户端通过FSDataOutputStream模块请求dn1上传数据(建立RPC请求),dn1收到请求会继续调用dn2,然后dn2调用dn3,将这个通信管道建立完成。

6)dn1、dn2、dn3逐级应答客户端。-应答成功,开始传输数据

7)客户端开始往dn1上传第一个block(先从磁盘读取数据放到一个本地内存缓存),以packet(默认 64K)为单位,dn1收到一个packet就会传给dn2,dn2传给dn3;dn1每传一个packet会放入一个应答队列等待应答。

128M他并不是一次性写入dn1,而是分包的形式,dn1接收到一个包,然后保存在自己所在服务器的本地缓存中。然后再写入自己磁盘(7_blk_1)的同时,传输给dn2,以此类推。直到传输完整个128M。第一块传输完毕。

8)当一个block传输完成之后,客户端再次请求namenode上传第二个block的服务器。(重复执行3-7步)。

4.1.2 网络拓扑概念

在本地网络中,两个节点被称为“彼此近邻”是什么意思?在海量数据处理中,其主要限制因素是节点之间数据的传输速率——带宽很稀缺。这里的想法是将两个节点间的带宽作为距离的衡量标准。

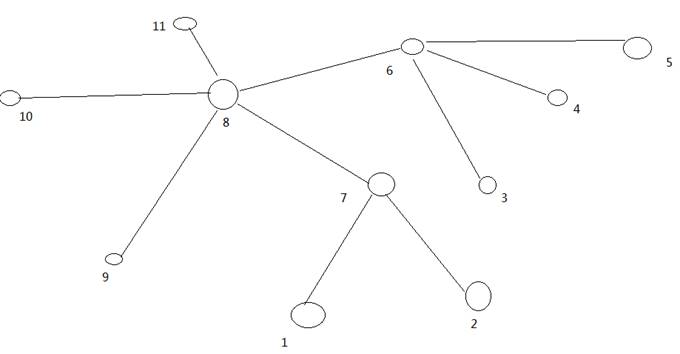

节点距离:两个节点到达最近的共同祖先的距离总和。

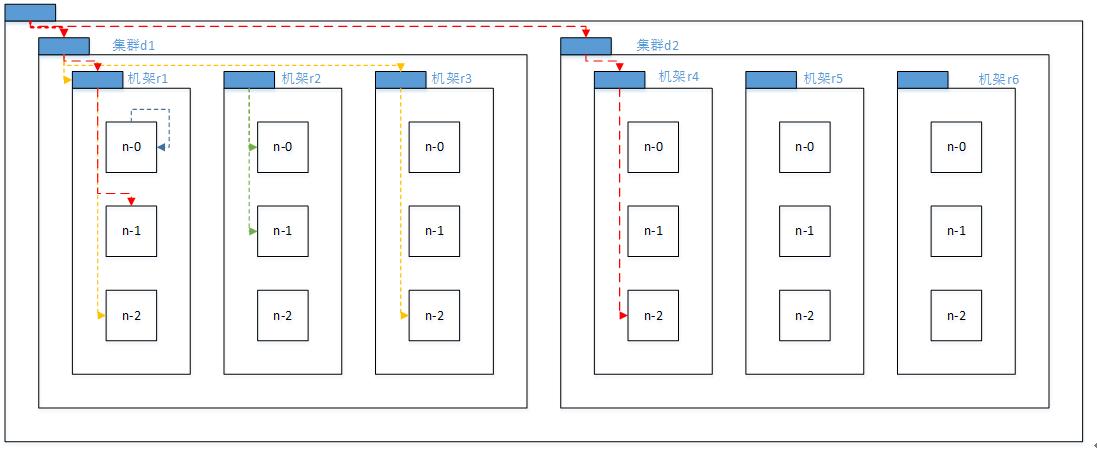

例如,假设有数据中心d1机架r1中的节点n1。该节点可以表示为/d1/r1/n1。利用这种标记,这里给出四种距离描述。

Distance(/d1/r1/n1, /d1/r1/n1)=0(同一节点上的进程)

Distance(/d1/r1/n1, /d1/r1/n2)=2(同一机架上的不同节点)

Distance(/d1/r1/n1, /d1/r3/n2)=4(同一数据中心不同机架上的节点)

Distance(/d1/r1/n1, /d2/r4/n2)=6(不同数据中心的节点)

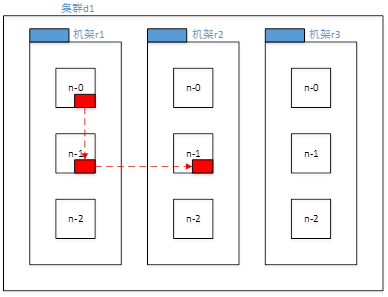

大家算一算每两个节点之间的距离。

4.1.3 机架感知(副本节点选择)

一份数据如果存在三个副本,那么副本存放服务器的选择,应该采取怎么样的策略

1)官方ip地址:

http://hadoop.apache.org/docs/r2.7.2/hadoop-project-dist/hadoop-common/RackAwareness.html

2)低版本Hadoop副本节点选择

第一个副本在client所处的节点上。如果客户端在集群外,随机选一个。

第二个副本和第一个副本位于不相同机架的随机节点上。

第三个副本和第二个副本位于相同机架,节点随机。

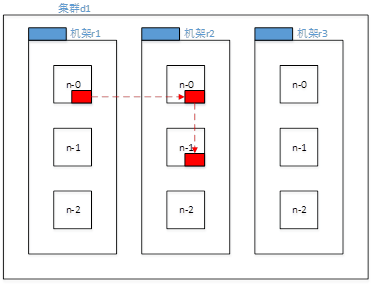

3)Hadoop2.7.2副本节点选择

第一个副本在client所处的节点上。如果客户端在集群外,随机选一个。

第二个副本和第一个副本位于相同机架,随机节点。

第三个副本位于不同机架,随机节点。

为什么第一个副本选择在客户端所在的节点,因为这样client**请求数据的时候,可以做到更快的响应,优先读取当前节点副本信息(设计网络拓扑概念),距离客户端越近的节点,数据传输速率越快**

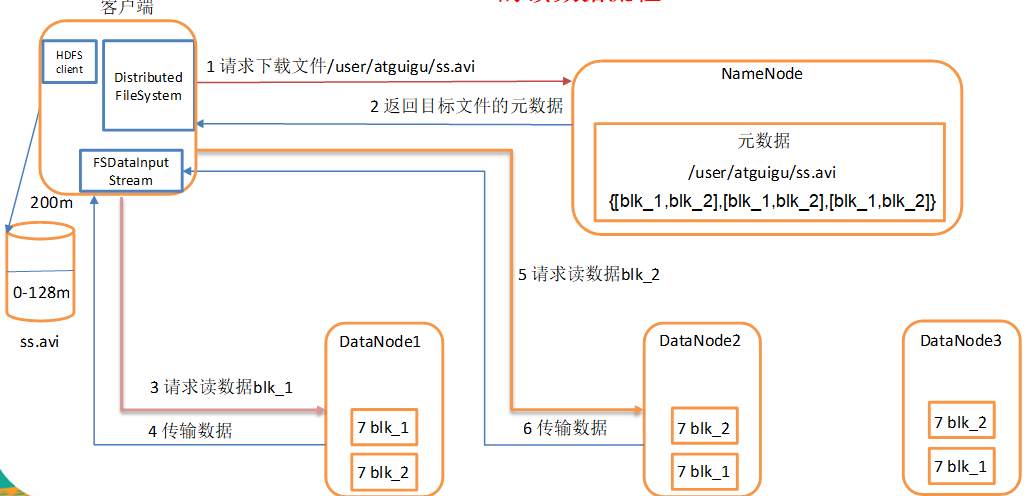

4.2 HDFS读数据流程

1)客户端通过Distributed FileSystem向namenode请求下载文件,namenode通过查询元数据,找到文件块所在的datanode地址。

2)挑选一台datanode(就近原则,然后随机)服务器,请求读取数据。

3)datanode开始传输数据给客户端(从磁盘里面读取数据放入流,以packet为单位来做校验)。

4)客户端以packet为单位接收,先在本地缓存,然后写入目标文件。

4.3 一致性模型

1)debug调试如下代码

@Test public void writeFile() throws Exception{ // 1 创建配置信息对象 Configuration configuration = new Configuration(); fs = FileSystem.get(configuration); // 2 创建文件输出流 Path path = new Path(“hdfs://hadoop102:9000/user/atguigu/hello.txt”); FSDataOutputStream fos = fs.create(path); // 3 写数据 fos.write(“hello”.getBytes()); // 4 一致性刷新 fos.hflush(); fos.close(); }

|

2)总结

写入数据时,如果希望数据被其他client立即可见,调用如下方法

FsDataOutputStream. hflush (); //清理客户端缓冲区数据,被其他client立即可见

因为传统的流操作,只有在关闭流的时候,才会去执行flush**操作,那么可能在关闭流之前发生错误,导致数据没有存储到对应的节点。为了避免这种问题,可以手动显式的执行flush**写入磁盘操作。(IOUtils. copyBytes 内部已经实现刷新机制,不需要手动刷新)